Vi sendas problemon rekte al la lingvomodelo kaj esperas ke la respondo estos ĝusta.

La naturo solvis ĉi tiun problemon antaŭ milionoj da jaroj.

En abelkolonio, malkovro ne fariĝas decido ĉar unu abelo decidas. La skolta abelo revenas al la abelujo kaj dancas ok-figuron sur la vertikala ĉelaro — la angulo montras direkton, la longo distancon, la forto kvaliton. Sed la danco ne estas monologo. Fratinaj abeloj sekvas la dancantinon, tuŝas ŝin per siaj antenoj kaj donas realtempan reagon. Halt-signaloj povas tute ĉesigi la dancon. Nur kiam la mesaĝo traeltenas socialan kontrolon, la vojo indas esti irita.

WaggleDance estas konstruita sur ĉi tiu logiko.

Ĝi ne donas la problemon rekte al LLM. Ĝi unue direktas ĝin al la ĝusta solvanto, validigas la rezulton per pluraj agentoj kaj uzas lingvomodelojn nur kiam ili vere helpas. Ĉiu paŝo postlasas spureblan vojon. Ĉiu solvo estas kontrolebla. Ĉiu ciklo kreskigas la propran scion de la sistemo.

La danco de la ok fariĝis algoritma vojigado. La ĉelaro fariĝis la MAGMA-memorstrukturo. Kaj la nokta dormo de la abeloj fariĝis Dream Mode — simulado en kiu la sistemo revizias la malsukcesojn de la tago, testas milojn da alternativaj vojoj kaj vekiĝas pli saĝa.

Ĉi tio ne estas metaforo. Ĉi tio estas la inĝenierado de kolektiva intelekto.

Elsutu, forku kaj rulu loke tuj. La tuta repo disponeblas sur GitHub sen registriĝo.

Permesilo: Apache 2.0 + BUSL 1.1 (malferma kerno + protektitaj moduloj). Vidu terminojn sur GitHub.

BUSL-ŝanĝodato: 18 marto 2030.

Solvantoj iras unue. La validigilo kontrolas. LLM envenas nur kiam la ĝusta solvanto ne sufiĉas.

MAGMA registras decidojn, fontojn, reludojn kaj fidpoentarojn. Vidu kio okazis, kial kaj en kiu ordo.

Dream Mode revizias malsukcesojn, simulas pli bonajn vojojn kaj konstruas pli bonajn modelojn por la sekva tago.

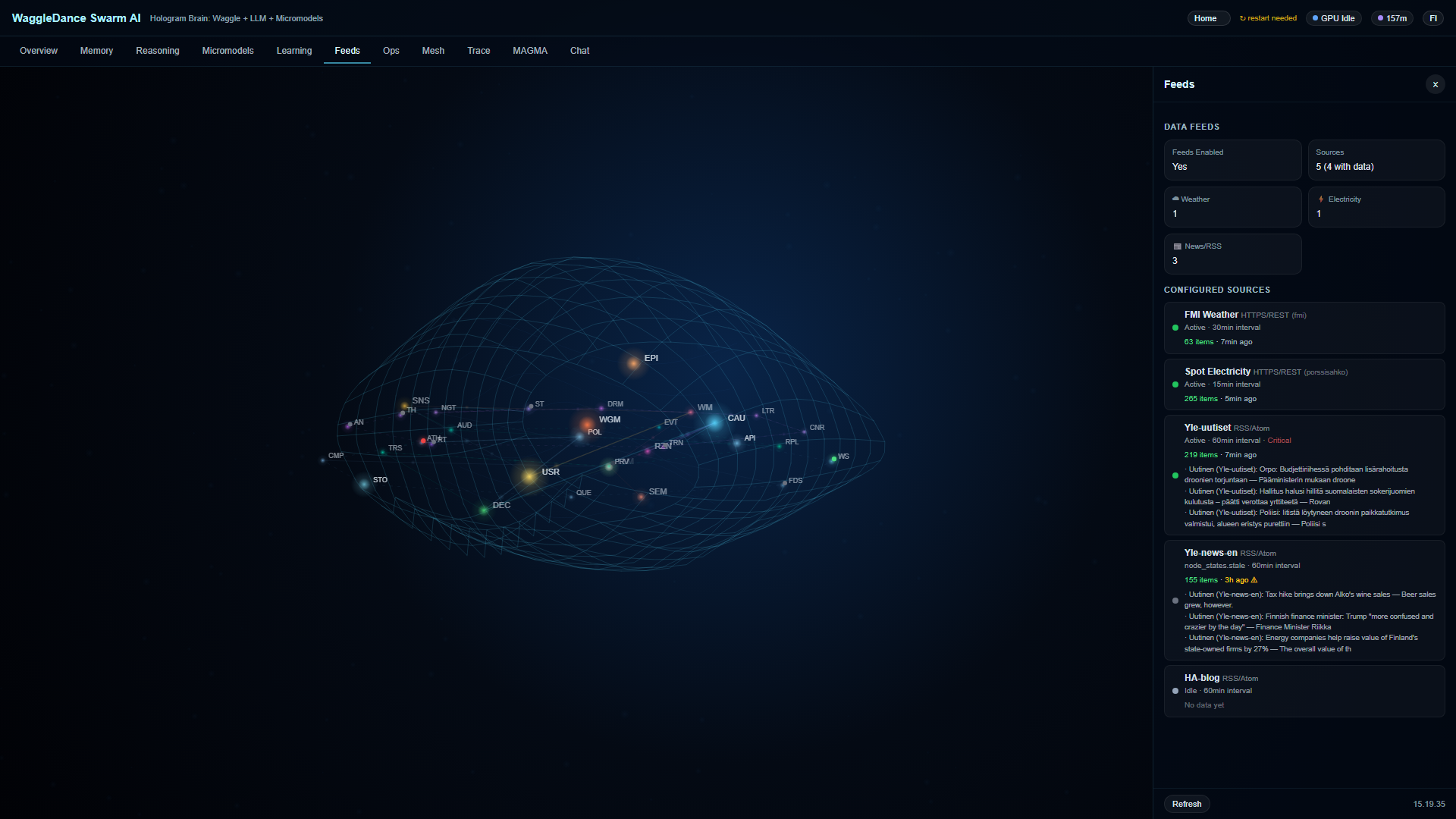

Hologram Brain igas la staton de 32 nodoj videbla realtempe. Vi ne vidas nigran skatolon — vi vidas aktivan sistemon.

Ĉio ruliĝas en via propra medio. Neniu deviga nubo, neniuj promptaj datumoj eliras, neniu SaaS-dependeco.

La sama kodo funkcias de Raspberry Pi ĝis fabrika profilo. Ne nur pruvo, ne nur framaro.

RPi, edge, sensilo

Senreta, intermita konekto

Hejma aŭtomatigo

Monitorado, anomalioj, revizio

Panelo kaj Hologram Brain disponeblas tuj post ekigo. La rapideco de la unua respondo dependas de profilo, aparataro kaj modo (kompleta aŭ stub).

La promptilo estas sendita rekte al Grok — kaj kopiita al via tondujo kiel rezerva kopio

Grok malfermiĝas en nova langeto kun la promptilo preta

Vi ricevas profundan repo-analizon, pritaksitan konkurentokomparon kaj industrian konvenec-taksadon

Se antaŭ plenigado ne funkcias, algluu permane — la promptilo jam estas en via tondujo.

Vi povas uzi la saman promptilon en Claude, ChatGPT aŭ iu ajn alia LLM. Grok estas la defaŭlta sur ĉi tiu paĝo.

Kiam vi klakas “Analizi repon”, la sistemo plenumas profundan analizon:

Ĉefa branĉo, strukturo, moduloj kaj lastatempaj enmetoj

Kio estas efektivigita kontraŭ kio estas planita aŭ aspirata

Test-kovrado, realisma matureco kaj produktpretigo

Memormodelo, revizia arkitekturo, deveno kaj fid-mekanismoj

Poentaro 1-10 sur ses aksoj kontraŭ Hejmo Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Industriaj uzkazoj, riskoj, mankantaj konektiloj, disvastigaj limigoj

Klaku promptilon por kopii. Algluu en vian Grok-seancon por pli profunda esplorado.

Elektu profilon kaj ricevu personecigitan disvastigan gvidilon de Grok.

Ĉiu ilo sube estas bona pri tio kion ĝi faras. La komparo montras kiel la solver-first arkitekturo de WaggleDance estas malsama — ne ke la aliaj estas malbonaj.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Hejmo Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Yes. Download and run immediately. Apache 2.0 parts are freely usable. Non-commercial personal use of BUSL-protected modules is permitted. For commercial use, check the license terms on GitHub.

No. WaggleDance is designed to work fully offline on local hardware. Internet is only needed for initial setup and updates.

Minimum: Raspberry Pi 4 or equivalent (GADGET profile). Recommended: modern x86 server for multi-agent orchestration (FACTORY profile).

You get a quick second technical opinion on the public repo, documentation, and competitive landscape. You can use the same prompt in Claude, ChatGPT, or any other LLM.

An auditing and provenance framework. Every agent decision is recorded so you get traceability, replay, and trust assessment visibility.

An overnight learning mode where the system reviews the day's failures, simulates better routes, and builds better models for the next day — automatically without user action.

Dashboard and Hologram Brain are available immediately. First response speed depends on profile and hardware.