Ils interrogent d'abord le modèle de langage et espèrent que la réponse sera correcte.

La nature a résolu ce problème il y a des millions d'années.

Dans la ruche, une découverte ne devient pas une décision simplement parce qu’un seul individu l’affirme. Une éclaireuse revient à la ruche et exécute une danse en huit sur la surface verticale du rayon — l’angle de la partie rectiligne indique la direction, la durée indique la distance et la vigueur indique la qualité. Mais la danse n’est pas un monologue. Les sœurs les plus expérimentées suivent la danseuse, la touchent avec leurs antennes et donnent un retour en temps réel. Un signal d’arrêt peut interrompre complètement la danse. Ce n’est que lorsque le message résiste à l’examen collectif qu’un itinéraire digne d’être suivi émerge.

WaggleDance repose sur cette même logique.

Il n’envoie pas le problème directement à un LLM. Il l’achemine d’abord vers le bon solver, vérifie le résultat avec plusieurs agents et n’utilise le modèle de langage que lorsqu’il aide réellement. Chaque étape laisse une trace auditable. Chaque solution est justifiable. Chaque cycle renforce l’expertise propre du système.

La danse en huit est devenue un routage algorithmique. Le rayon est devenu l’architecture mémoire MAGMA. Et le repos nocturne des abeilles est devenu Dream Mode — une simulation dans laquelle le système examine les échecs de la journée, teste des milliers de chemins alternatifs et revient le matin plus sage.

Ce n'est pas une métaphore. C'est l'architecture de l'intelligence machine collective.

Téléchargez, forkez et exécutez localement dès maintenant. Le dépôt complet est disponible sur GitHub sans inscription.

Modèle de licence : Apache 2.0 + BUSL 1.1 (code ouvert + modules protégés disponibles avec source). Consultez les conditions sur GitHub.

Date de conversion du module BUSL : 18 mars 2030.

Solver d'abord. Le vérificateur contrôle. Le LLM n'intervient que si aucun solver adéquat n'existe.

MAGMA enregistre les décisions, les sources, les rejeux et les scores de confiance. Voyez ce qui s'est passé, pourquoi et dans quel ordre.

Dream Mode examine les échecs, simule de meilleurs chemins et construit de meilleurs modèles pour le lendemain.

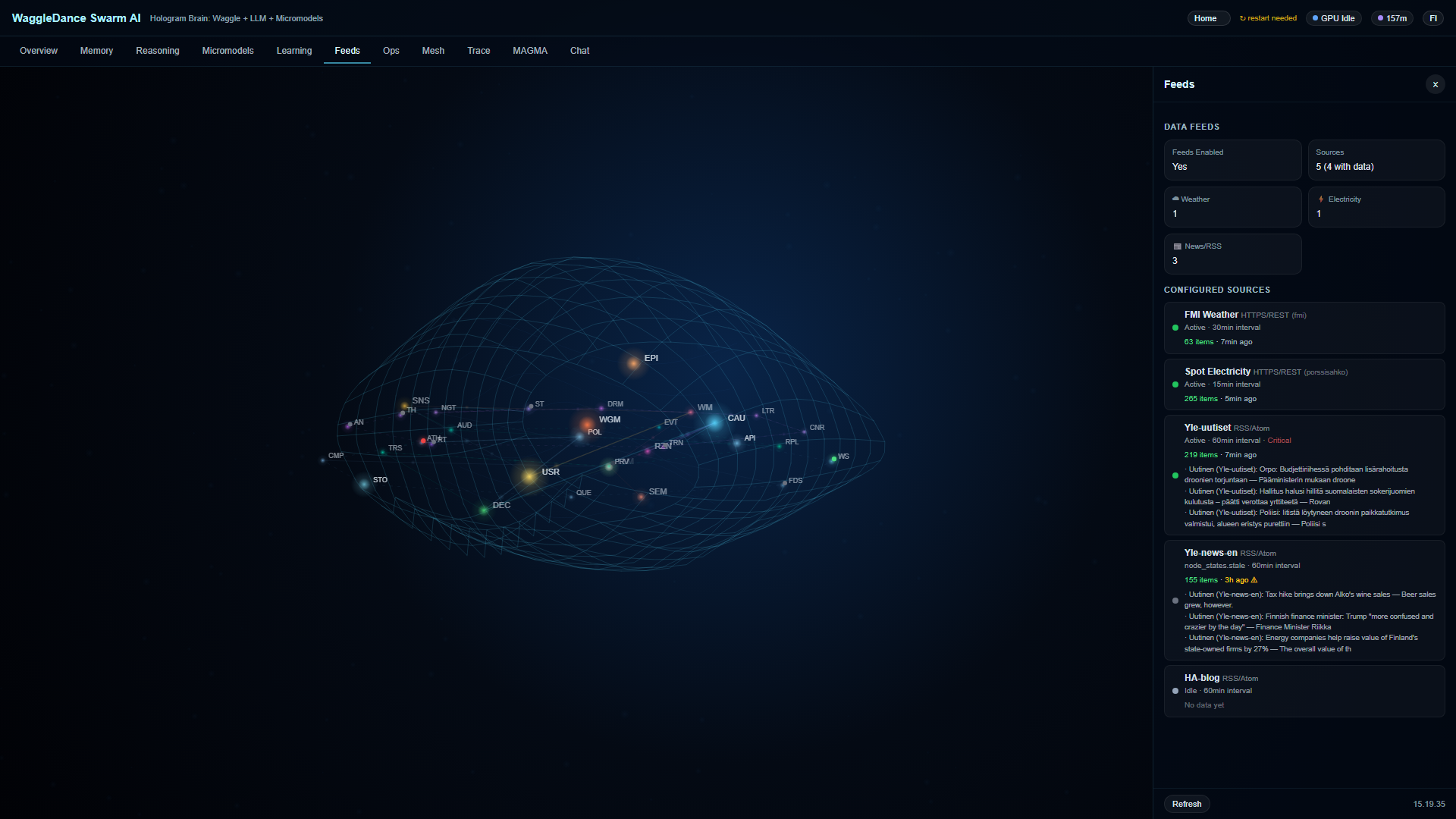

Hologram Brain affiche l’état de 32 nœuds en temps réel. Vous ne regardez pas une boîte noire — vous regardez un système en fonctionnement.

Tout fonctionne dans votre environnement. Pas de cloud obligatoire, pas de fuite de données de prompts, pas de dépendance SaaS.

Une même base de code fonctionne du Raspberry Pi au profil usine. Ce n’est pas seulement une démo, ni seulement un framework.

RPi, edge, capteurs

Hors ligne, connexion intermittente

Automatisation locale

Surveillance, anomalies, audit

Dashboard et Hologram Brain disponibles immédiatement après le démarrage. La vitesse de la première réponse dépend du profil, du matériel et du mode complet/stub.

Le prompt est envoyé directement à Grok — et copié dans le presse-papiers en sauvegarde

Grok s'ouvre dans un nouvel onglet avec le prompt préparé

Vous obtenez une analyse complète, une comparaison avec les concurrents notée et une évaluation de préparation usine

Si le pré-remplissage ne fonctionne pas, collez manuellement — le prompt est déjà dans le presse-papiers.

Vous pouvez utiliser le même prompt dans Claude, ChatGPT ou tout autre LLM. Grok est le choix par défaut sur cette page.

Quand vous cliquez sur “Analyser le dépôt”, l'IA effectue une analyse approfondie :

Branche principale, architecture, modules et commits les plus récents

Ce qui est implémenté vs ce qui est planifié ou simplement envisagé

Couverture des tests, maturité pratique et préparation à la production

Modèle mémoire, architecture d’audit, provenance et mécanismes de confiance

Score 1-10 sur six axes : Maison Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Usage industriel, risques, intégration SCADA/OPC, obstacles de déploiement

Cliquez sur un prompt pour le copier. Collez dans la session Grok pour une recherche approfondie.

Choisissez un profil et obtenez un guide de déploiement personnalisé de Grok.

Chaque outil ci-dessous est bon dans son domaine. La comparaison vise à montrer la différence de l'architecture solver-d'abord de WaggleDance — pas à dénigrer les autres.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Maison Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Oui. Téléchargez et exécutez immédiatement. La partie Apache 2.0 est libre d'utilisation. Pour un usage commercial, consultez la licence sur GitHub.

Non. WaggleDance est conçu pour fonctionner entièrement hors ligne.

Minimum : Raspberry Pi 4 (GADGET). Recommandé : serveur x86 (FACTORY).

Un deuxième avis technique rapide sur un dépôt public. Vous pouvez utiliser le même prompt dans Claude, ChatGPT ou tout autre LLM.

Framework d'audit et de provenance. Chaque décision est enregistrée.

Mode d'apprentissage nocturne qui apprend des échecs et construit de meilleurs modèles — automatiquement.

Dashboard et Hologram Brain disponibles immédiatement. La vitesse dépend du profil et du matériel.