Tinatanong muna nila ang language model at umaasang tama ang sagot.

Nalutas ng kalikasan ang problemang ito milyun-milyong taon na ang nakakaraan.

Sa loob ng isang bahay-pukyutan, ang isang pagtuklas ay hindi nagiging desisyon dahil lang sinabi iyon ng iisang kalahok. Bumabalik sa bahay-pukyutan ang isang tagapagmanman na pukyutan at sumasayaw ng hugis-walo sa patayong ibabaw ng bahay-pukyutan — ang anggulo ng tuwid na bahagi ay nagtuturo ng direksiyon, ang tagal ay nagsasaad ng distansya, at ang sigla ay nagsasaad ng kalidad. Ngunit ang sayaw ay hindi monologo. Sinusundan ng mas may karanasang mga kapatid na pukyutan ang mananayaw, hinahawakan siya gamit ang kanilang mga antenna, at nagbibigay ng feedback nang real time. Maaaring ganap na ihinto ng isang stop signal ang sayaw. Tanging kapag nakalampas ang mensahe sa pagsusuri ng komunidad saka lumilitaw ang rutang karapat-dapat tahakin.

Ang WaggleDance ay itinayo sa lohikang ito.

Hindi nito ibinibigay nang direkta ang problema sa isang LLM. Iniruruta muna nito ang problema sa tamang solver, pinatutunayan ang resulta sa pamamagitan ng maraming agent, at ginagamit lamang ang language model kapag tunay itong nakakatulong. Bawat hakbang ay nag-iiwan ng audit trail na masusuri. Bawat solusyon ay maipapaliwanag. Bawat cycle ay nagpapalago sa sariling kadalubhasaan ng sistema.

Ang hugis-walong sayaw ay naging algorithmic routing. Ang anila ay naging MAGMA memory architecture. At ang magdamag na pahinga ng mga pukyutan ay naging Dream Mode — isang simulation kung saan sinusuri ng sistema ang mga pagkabigo sa maghapon, sinusubok ang libu-libong alternatibong ruta, at bumabalik sa umaga nang mas matalino.

Hindi ito metapora. Ito ay arkitektura para sa collective machine intelligence.

I-download, i-fork, at patakbuhin nang lokal kaagad. Ang buong repo ay available sa GitHub nang walang rehistrasyon.

License model: Apache 2.0 + BUSL 1.1 (open core + source-available protected modules). Check the terms on GitHub.

BUSL module change date: March 18, 2030.

Nauuna ang solvers. Sinusuri ng verifier. Sumasali lang ang LLM kapag hindi sapat ang tamang solver.

Nagrerekord ang MAGMA ng mga desisyon, pinagmulan, replay, at trust scores. Tingnan kung ano ang nangyari, bakit, at sa anong pagkakasunod-sunod.

Sinusuri ng Dream Mode ang mga pagkabigo, nagsi-simulate ng mas magagandang ruta, at gumagawa ng mas magagandang modelo para sa susunod na araw.

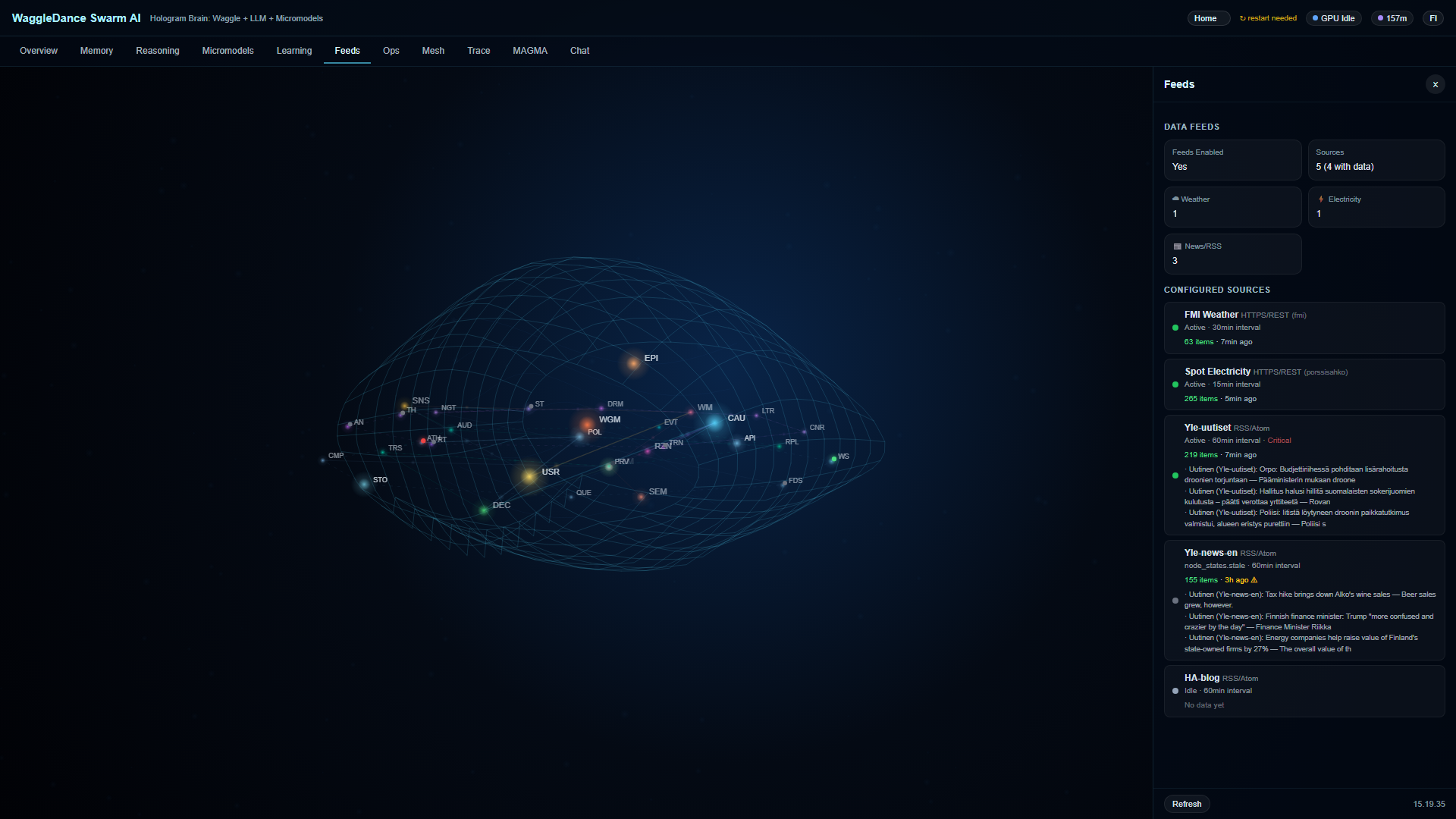

Ginagawa ng Hologram Brain ang estado ng 32 nodes na nakikita sa real time. Hindi ka nakatingin sa black box — nakatingin ka sa isang tumatakbong sistema.

Lahat ay tumatakbo sa sariling environment. Walang sapilitang cloud, walang prompt data na lumalabas, walang SaaS dependency.

Ang parehong codebase ay gumagana mula Raspberry Pi hanggang factory profile. Hindi lamang demo, hindi lamang framework.

RPi, edge, sensor

Offline, paulit-ulit na koneksyon

Lokal na automation

Monitoring, anomalya, audit

Ang Dashboard at Hologram Brain ay agad na available pagkatapos ng startup. Depende ang bilis ng unang tugon sa profile, hardware, at kung full o stub mode ang ginagamit.

Ang prompt ay direktang ipinapadala sa Grok — at kinokopya sa iyong clipboard bilang backup

Bumubukas ang Grok sa isang bagong tab na may handang prompt

Makakakuha ka ng komprehensibong pagsusuri ng repo, may iskor na paghahambing sa mga kakumpitensya, at pagtatasa ng kahandaan ng pabrika.

Kung hindi gumana ang pre-fill, i-paste nang manu-mano — ang prompt ay nasa iyong clipboard na.

Maaari mo ring gamitin ang parehong prompt sa Claude, ChatGPT, o anumang iba pang LLM. Ang Grok ang default na pagpipilian sa pahinang ito.

Kapag nag-click ka ng “Suriin ang Repository”, ang AI ay nagsasagawa ng malalim na pagsusuri na sumasaklaw sa:

Pangunahing sangay, arkitektura, mga module, at pinakabagong mga commit

Ano ang naipatupad vs ano ang binabalak o hangarin

Coverage ng pagsusulit, praktikal na karampatan, at kahandaan sa produksyon

Memory model, arkitektura ng audit, provenance, at mga trust mechanism

Nakaiskor 1-10 sa anim na axes laban sa Bahay Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Mga industrial use case, panganib, kulang na integrasyon, mga hadlang sa deployment

Mag-click sa isang prompt upang kopyahin ito. I-paste sa iyong Grok session para sa mas malalim na pag-explore.

Pumili ng profile at makakuha ng customized na gabay sa deployment mula sa Grok.

Ang bawat tool sa ibaba ay mahusay sa kanyang ginagawa. Ang paghahambing ay nagpapakita kung paano naiiba ang solver-first na pagkakabuo ng WaggleDance — hindi upang sabihing masama ang iba.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Bahay Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Yes. Download and run immediately. Apache 2.0 parts are freely usable. Non-commercial personal use of BUSL-protected modules is permitted. For commercial use, check the license terms on GitHub.

No. WaggleDance is designed to work fully offline on local hardware. Internet is only needed for initial setup and updates.

Minimum: Raspberry Pi 4 or equivalent (GADGET profile). Recommended: modern x86 server for multi-agent orchestration (FACTORY profile).

You get a quick second technical opinion on the public repo, documentation, and competitive landscape. You can use the same prompt in Claude, ChatGPT, or any other LLM.

An auditing and provenance framework. Every agent decision is recorded so you get traceability, replay, and trust assessment visibility.

An overnight learning mode where the system reviews the day's failures, simulates better routes, and builds better models for the next day — automatically without user action.

Dashboard and Hologram Brain are available immediately. First response speed depends on profile and hardware.