Primero consultan al modelo de lenguaje y esperan que la respuesta sea correcta.

La naturaleza resolvió este problema hace millones de años.

En la colmena, un descubrimiento no se convierte en decisión porque alguien lo diga. Una exploradora regresa a la colmena y baila en forma de 8 sobre la superficie vertical del panal — el ángulo de la sección recta indica la dirección, la duración indica la distancia, la intensidad indica la calidad. Pero el baile no es un monólogo. Las hermanas más experimentadas siguen a la bailarina, la tocan con sus antenas y proporcionan retroalimentación en tiempo real. Una señal de parada puede detener el baile por completo. Solo cuando el mensaje sobrevive al escrutinio comunitario surge una ruta que merece seguirse.

WaggleDance se basa en esta misma lógica.

No envía el problema directamente al LLM. Primero enruta al solver correcto, verifica los resultados con múltiples agentes, y utiliza el modelo de lenguaje solo cuando realmente ayuda. Cada paso deja un registro auditable. Cada solución está justificada con argumentos. Cada ciclo aumenta la experiencia del sistema.

La danza en forma de 8 se convirtió en enrutamiento algorítmico. El panal se convirtió en la arquitectura de memoria MAGMA. Y el descanso nocturno de las abejas se convirtió en Dream Mode — una simulación en la que el sistema revisa los fracasos del día, prueba miles de rutas alternativas y amanece más inteligente.

Esto no es una metáfora. Es la arquitectura de inteligencia de máquina colectiva.

Descargue, haga fork y ejecute localmente ahora. El repositorio completo está disponible en GitHub sin registro.

Modelo de licencia: Apache 2.0 + BUSL 1.1 (código abierto + módulos protegidos disponibles con fuente). Consulte los términos en GitHub.

Fecha de conversión del módulo BUSL: 18 de marzo de 2030.

Solver primero. El verificador comprueba. El LLM solo entra cuando el solver adecuado no es suficiente.

MAGMA registra decisiones, fuentes, reproducciones y puntuaciones de confianza. Vea qué pasó, por qué y en qué orden.

Dream Mode revisa los fracasos, simula mejores caminos y construye mejores modelos para el día siguiente.

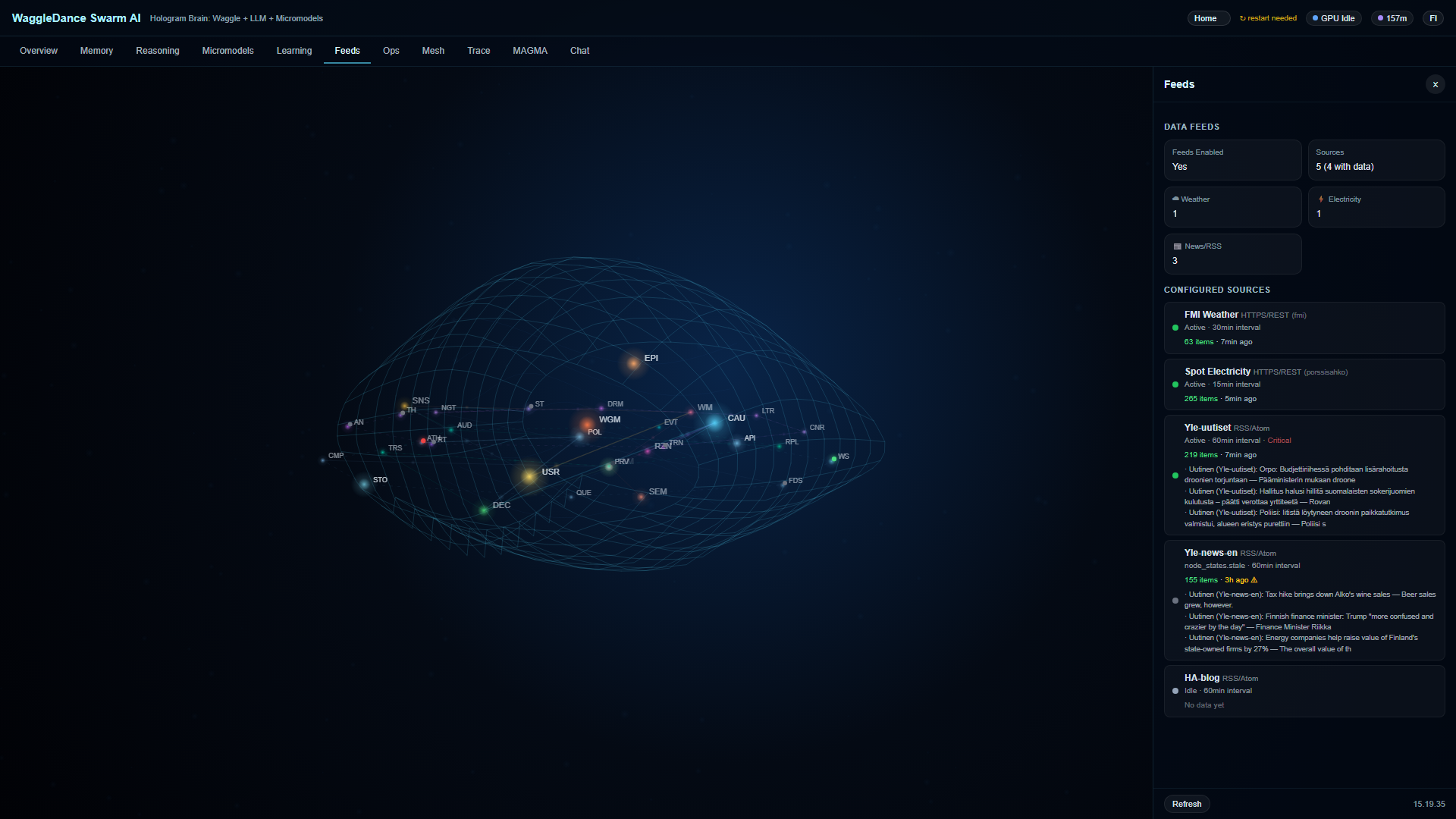

Hologram Brain muestra el estado de 32 nodos en tiempo real. No verá cajas negras — verá un sistema trabajando.

Todo funciona en su entorno. Sin nube obligatoria, sin filtraciones de datos de prompts, sin dependencia SaaS.

Un mismo código desde Raspberry Pi hasta perfil de fábrica. No solo demo, no solo framework.

RPi, edge, sensores

Offline, conexión intermitente

Automatización local

Monitoreo, anomalías, auditoría

Dashboard y Hologram Brain están disponibles inmediatamente después del arranque. La velocidad de la primera respuesta depende del perfil, el hardware y de si se usa el modo completo o el modo stub.

El prompt se envía directamente a Grok — y se copia al portapapeles como respaldo

Grok se abre en una nueva pestaña con el prompt preparado

Obtiene un análisis completo del repositorio, una comparación puntuada con competidores y una evaluación de preparación para fábrica

Si el pre-llenado no funciona, pegue manualmente — el prompt ya está en el portapapeles.

Puede usar el mismo prompt en Claude, ChatGPT o cualquier otro LLM. Grok es la opción predeterminada en esta página.

Cuando hace clic en “Analizar el repositorio”, la IA realiza un análisis profundo:

Rama principal, arquitectura, módulos y commits más recientes

Qué está implementado vs qué es aspiracional o planificado

Cobertura de pruebas, madurez práctica y preparación para producción

Modelo de memoria, arquitectura de auditoría, trazabilidad y mecanismos de confianza

Puntuación 1-10 en seis ejes: Hogar Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Uso industrial, riesgos, integración con SCADA/OPC, obstáculos de despliegue

Haga clic en un prompt para copiarlo. Pegue en la sesión de Grok para investigación profunda.

Elija un perfil y obtenga una guía de despliegue personalizada de Grok.

Cada herramienta de abajo es buena en lo suyo. La comparación es para mostrar la diferencia de la arquitectura solver-primero de WaggleDance — no para desprestigiar a otros.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Hogar Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Sí. Descargue y ejecute inmediatamente. La parte Apache 2.0 es de uso libre. Para uso comercial, consulte la licencia en GitHub.

No. WaggleDance está diseñado para funcionar completamente offline.

Mínimo: Raspberry Pi 4 (GADGET). Recomendado: servidor x86 (FACTORY).

Una segunda opinión técnica rápida sobre un repositorio público. Puede usar el mismo prompt en Claude, ChatGPT o cualquier LLM.

Framework de auditoría y trazabilidad. Cada decisión queda registrada.

Modo de aprendizaje nocturno que aprende de los fracasos y construye mejores modelos — automático.

Dashboard y Hologram Brain disponibles inmediatamente. La velocidad depende del perfil y hardware.