まず言語モデルに質問し、回答がもっともらしいことを祈るのです。

自然界はこの問題を数百万年前に解決していました。

ミツバチの巣では、発見が一匹の意見だけで決定にはなりません。偵察バチは巣に戻り、垂直な巣板の上で8の字ダンスを踊ります。直進部分の角度が方向を示し、持続時間が距離を示し、力強さが質を示します。しかしこのダンスは一方通行ではありません。経験豊富な姉妹バチがダンサーに従い、触角で触れ、リアルタイムでフィードバックを行います。停止信号はダンスを完全に中断させることもあります。メッセージがコミュニティの精査を通過したときにのみ、従う価値のあるルートが生まれるのです。

WaggleDanceはこの論理に基づいて構築されています。

問題を直接LLMに渡すことはしません。まず適切なソルバーにルーティングし、複数のエージェントで結果を検証し、言語モデルは本当に役立つ場合にのみ使用します。すべてのステップが監査可能な記録を残します。すべての解決策には根拠があります。すべてのサイクルがシステム自身の専門知識を向上させます。

8の字ダンスはアルゴリズミックルーティングになりました。ハニカムはMAGMAメモリアーキテクチャになりました。そしてミツバチの夜間休息はDream Modeになりました — システムがその日の失敗をレビューし、数千の代替パスをテストし、翌朝より賢くなって戻るシミュレーションです。

これは比喩ではありません。これは集合的機械知能のアーキテクチャです。

今すぐダウンロード、フォークして、ローカルで実行できます。リポジトリ全体がGitHubで登録不要で利用可能です。

ライセンスモデル: Apache 2.0 + BUSL 1.1(オープンコア + ソースコード公開の保護モジュール)。条件はGitHubでご確認ください。

BUSLモジュール変更日: 2030年3月18日。

ソルバーが先に動きます。検証器がチェックします。適切なソルバーでは不十分な場合にのみLLMが参加します。

MAGMAは決定、ソース、リプレイ、信頼スコアを記録します。何が起きたか、なぜ、どの順序で起きたかを確認できます。

Dream Modeが失敗をレビューし、より良いルートをシミュレーションし、翌日のためにより良いモデルを構築します。

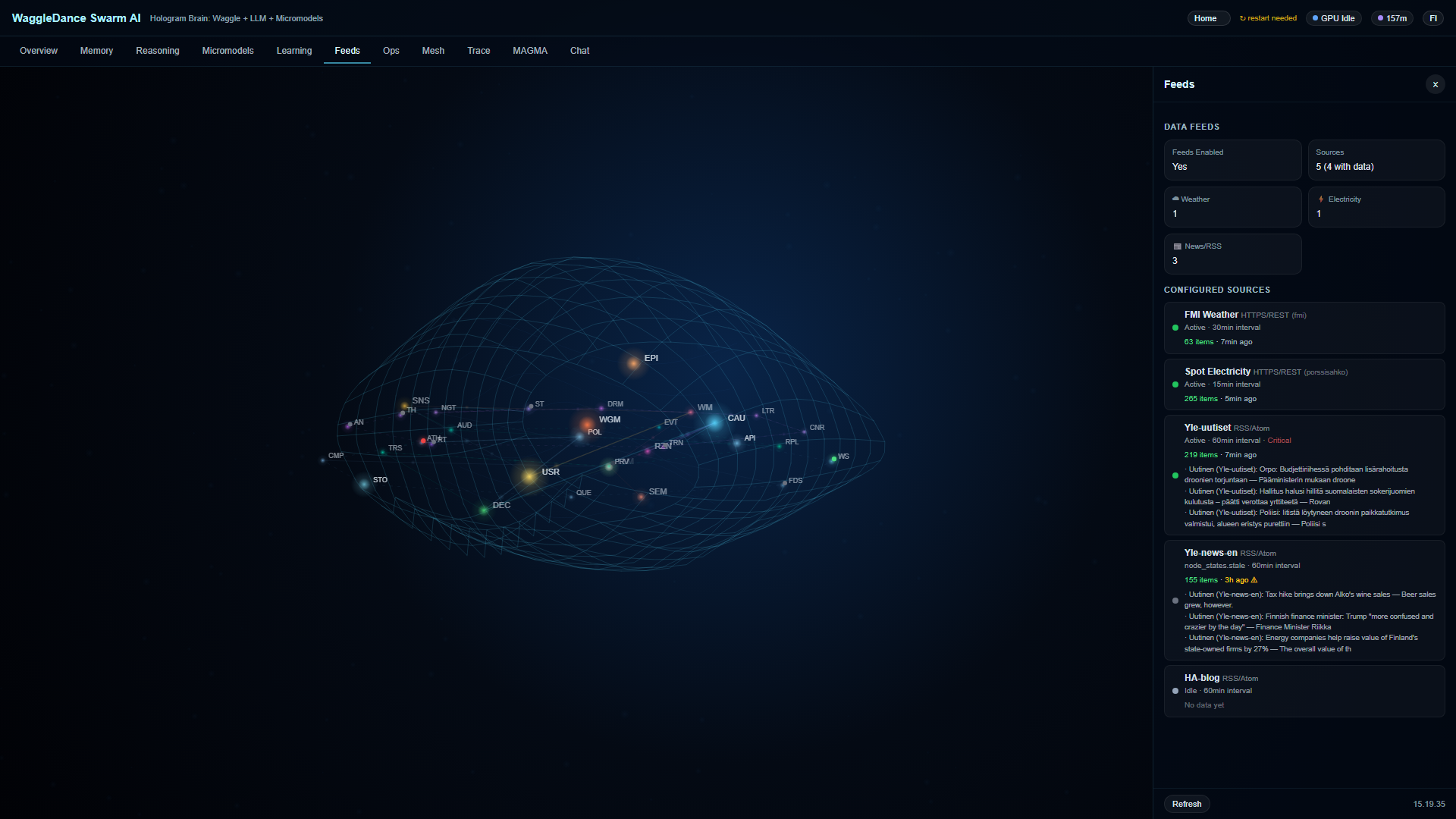

Hologram Brainが32ノードの状態をリアルタイムで可視化します。ブラックボックスではなく、稼働中のシステムを見ることができます。

すべて自社環境で実行されます。クラウド強制なし、プロンプトデータの外部送信なし、SaaS依存なし。

Raspberry Piから工場プロファイルまで同一のコードベースで動作します。単なるデモでも、単なるフレームワークでもありません。

RPi、エッジ、センサー

オフライン、間欠接続

ローカルオートメーション

監視、異常検知、監査

起動後すぐにダッシュボードとHologram Brainが利用可能です。初回応答速度はプロファイル、ハードウェア、フルモードかスタブモードかにより異なります。

プロンプトがGrokに直接送信され、バックアップとしてクリップボードにもコピーされます

Grokが新しいタブでプロンプトとともに開きます

リポジトリの包括的な分析、スコア付き競合比較、産業利用対応度の評価が得られます

プリフィルが機能しない場合は、手動で貼り付けてください — プロンプトはすでにクリップボードにあります。

同じプロンプトをClaude、ChatGPT、その他のLLMでも使用できます。このページではGrokがデフォルトの選択肢です。

“リポジトリを分析”をクリックすると、AIが以下の項目を深く分析します:

メインブランチ、アーキテクチャ、モジュール、最新のコミット

実装済みの機能と計画中または目標段階の機能

テストカバレッジ、実用的な成熟度、プロダクション対応度

メモリモデル、監査アーキテクチャ、出所追跡、信頼メカニズム

ホーム Assistant、Node-RED、n8n、Open WebUI、LangGraph、AutoGen、CrewAI、Ollamaと6軸で1-10のスコアリング

産業ユースケース、リスク、不足している統合、デプロイメントの阻害要因

プロンプトをクリックしてコピーしてください。Grokセッションに貼り付けてより深く探索できます。

プロファイルを選択して、Grokからカスタマイズされたデプロイメントガイドを取得してください。

以下の各ツールはそれぞれの分野で優れています。この比較はWaggleDanceのソルバーファースト・ルーティングアーキテクチャがどう異なるかを示すもので、他のツールが劣っていると主張するものではありません。

clone → docker compose up -d — Ollama、Voikko(フィンランド語NLP)、アプリがすべて一体。時間とともに自律的に改善する競合は存在しません。WaggleDanceだけが累積的な専門知識を構築します。

| 期間 | WaggleDance | ホーム Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| 初日 | LLMフォールバック約30-50%、ソルバー学習中 | 変化なし | 変化なし | 変化なし | 変化なし | 変化なし |

| 1か月後 | HotCacheが蓄積、LLM約20-30%、最初のカナリア昇格 | 変化なし | 変化なし | 変化なし | 変化なし | 変化なし |

| 6か月後 | LLM約10-15%、専門モデル成熟、Dream Mode約180夜分 | 変化なし | 変化なし | 変化なし | 変化なし | 変化なし |

| 1年後 | LLM約5-8%、MAGMAに数千の監査済みパス | 変化なし | 変化なし | 変化なし | 変化なし | 変化なし |

| 2年後 | LLM 3-5%未満、95%以上が決定論的、TCOは初日の数分の一 | 変化なし | 変化なし | 変化なし | 変化なし | 変化なし |

競合の列は初日以外すべて空です。彼らは学習しません。改善しません。730日目も初日とまったく同じです。

はい。すぐにダウンロードして実行できます。Apache 2.0の部分は自由に使用可能です。BUSL保護モジュールの非商用個人利用は許可されています。商用利用についてはGitHubのライセンス条項をご確認ください。

いいえ。WaggleDanceはローカルハードウェアで完全にオフラインで動作するよう設計されています。インターネットは初期セットアップとアップデート時のみ必要です。

最低要件: Raspberry Pi 4または同等品(GADGETプロファイル)。推奨: マルチエージェントオーケストレーション用の最新x86サーバー(FACTORYプロファイル)。

公開リポジトリ、ドキュメント、競合環境について迅速な技術的セカンドオピニオンが得られます。同じプロンプトをClaude、ChatGPT、その他のLLMでも使用できます。

監査と出所追跡のフレームワークです。すべてのエージェントの決定が記録され、トレーサビリティ、リプレイ、信頼性評価の可視性が得られます。

一晩の学習モードです。システムがその日の失敗をレビューし、より良いルートをシミュレーションし、翌日のためのより良いモデルを構築します — ユーザーの操作なしで自動的に行われます。

ダッシュボードとHologram Brainがすぐに利用可能になります。初回応答速度はプロファイルとハードウェアによって異なります。