De spør språkmodellen først og håper svaret høres riktig ut.

Naturen løste dette problemet for millioner av år siden.

I en bikube blir en oppdagelse ikke en beslutning fordi én aktør sier det. En speider vender tilbake til kuben og danser et åttetall på den vertikale voksskiven — vinkelen på den rette delen angir retning, varigheten angir avstand, kraften angir kvalitet. Men dansen er ingen monolog. Søsterbier følger danseren, kjenner på henne med antennene og gir tilbakemelding i sanntid. Stoppsignaler kan avbryte dansen helt. Bare når budskapet overlever samfunnets granskning, oppstår en rute verdt å følge.

WaggleDance er bygget på denne logikken.

Den overleverer ikke problemet direkte til en LLM. Den ruter det først til riktig løser, verifiserer resultatet gjennom flere agenter og bruker språkmodeller bare når de virkelig hjelper. Hvert trinn etterlater et revisjonsspor. Hver løsning er begrunnbar. Hver syklus bygger systemets egen ekspertise.

Åttetallsdansen ble algoritmisk ruting. Voksskiven ble MAGMA-minnestrukturen. Og biens nattlige hvile ble Dream Mode — en simulering der systemet gjennomgår dagens feil, tester tusenvis av alternative ruter og våkner smartere.

Dette er ingen metafor. Dette er en arkitektur for kollektiv maskinintelligens.

Last ned, fork og kjør lokalt med en gang. Hele repoet er tilgjengelig på GitHub uten registrering.

Lisensmodell: Apache 2.0 + BUSL 1.1 (åpen kjerne + kildetilgjengelige beskyttede moduler). Se vilkår på GitHub.

BUSL-overgangsdato: 18. mars 2030.

Løsere går først. Verifikatoren sjekker. LLM-en kobles inn bare når riktig løser ikke strekker til.

MAGMA registrerer beslutninger, kilder, avspillinger og tillitspoeng. Se hva som skjedde, hvorfor og i hvilken rekkefølge.

Dream Mode gjennomgår feil, simulerer bedre ruter og bygger bedre modeller til neste dag.

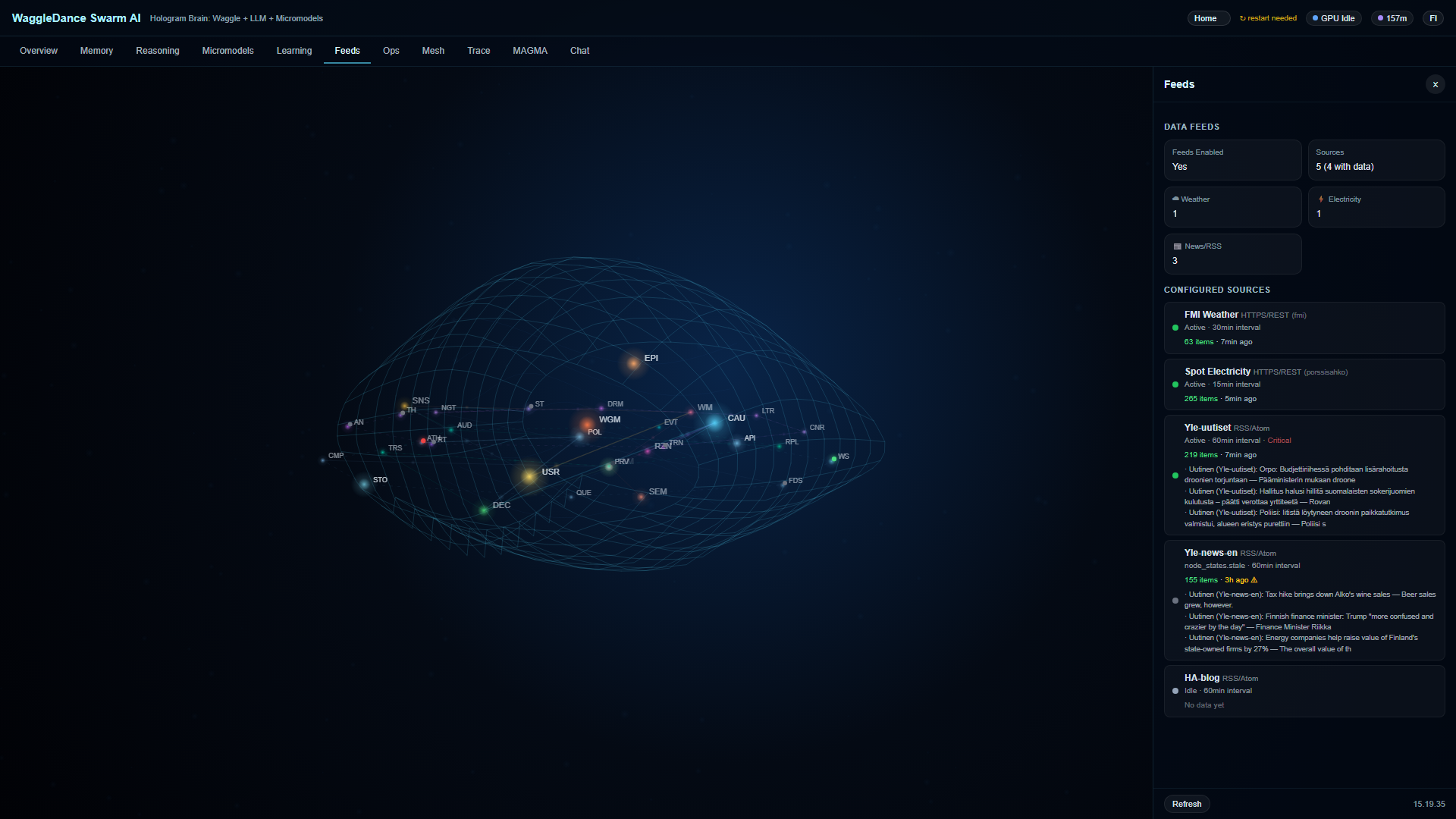

Hologram Brain gjør tilstanden til 32 noder synlig i sanntid. Du ser ikke på en svart boks — du ser på et fungerende system.

Alt kjøres i ditt eget miljø. Ingen obligatorisk sky, ingen promptdata forlater huset, ingen SaaS-avhengighet.

Samme kodebase fungerer fra Raspberry Pi til fabrikkprofil. Ikke bare en demo, ikke bare et rammeverk.

RPi, edge, sensor

Offline, ustabil tilkobling

Lokal automasjon

Overvåking, avvik, revisjon

Dashboard og Hologram Brain er tilgjengelige umiddelbart etter oppstart. Første responstid avhenger av profil, maskinvare og full- eller stub-modus.

Prompten sendes direkte til Grok — og kopieres til utklippstavlen som sikkerhetskopi

Grok åpnes i en ny fane med prompten klar

Du får en omfattende analyse av repoet, en poengsatt konkurrentsammenligning og en vurdering av fabrikkberedskap.

Hvis forhåndsutfylling ikke virker, lim inn manuelt — prompten er allerede på utklippstavlen.

Du kan også bruke samme prompt i Claude, ChatGPT eller en hvilken som helst annen LLM. Grok er standardvalget på denne siden.

Når du klikker “Analyser repo”, utfører AI-en en dyp analyse som dekker:

Hovedgren, arkitektur, moduler og siste commits

Hva som er implementert vs. hva som er planlagt eller strategisk

Testdekning, praktisk modenhet og produksjonsberedskap

Minnemodell, revisjonsarkitektur, opprinnelse og tillitsmekanismer

Poengsatt 1-10 på seks akser mot Hjem Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Industrielle brukstilfeller, risikoer, manglende integrasjoner, utrullingshindere

Klikk på en prompt for å kopiere den. Lim inn i Grok-økten din for dypere utforskning.

Velg en profil og få en skreddersydd utrullingsveiledning fra Grok.

Hvert verktøy nedenfor er bra på det det gjør. Sammenligningen viser hvordan WaggleDances solver-first-arkitektur skiller seg — ikke for å si at andre er dårlige.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Hjem Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Yes. Download and run immediately. Apache 2.0 parts are freely usable. Non-commercial personal use of BUSL-protected modules is permitted. For commercial use, check the license terms on GitHub.

No. WaggleDance is designed to work fully offline on local hardware. Internet is only needed for initial setup and updates.

Minimum: Raspberry Pi 4 or equivalent (GADGET profile). Recommended: modern x86 server for multi-agent orchestration (FACTORY profile).

You get a quick second technical opinion on the public repo, documentation, and competitive landscape. You can use the same prompt in Claude, ChatGPT, or any other LLM.

An auditing and provenance framework. Every agent decision is recorded so you get traceability, replay, and trust assessment visibility.

An overnight learning mode where the system reviews the day's failures, simulates better routes, and builds better models for the next day — automatically without user action.

Dashboard and Hologram Brain are available immediately. First response speed depends on profile and hardware.