Wysyłają problem bezpośrednio do modelu językowego i mają nadzieję, że odpowiedź będzie właściwa.

Natura rozwiązała ten problem miliony lat temu.

W pszczelim ulu odkrycie nie staje się decyzją dlatego, że jedna pszczoła tak postanawia. Zwiadowczyni wraca do ula i tańczy ósemkę na pionowym plastrze — kąt wskazuje kierunek, długość odległość, intensywność jakość. Ale taniec nie jest monologiem. Pszczoły-siostry śledzą tancerkę, dotykają jej czułkami i dają informację zwrotną w czasie rzeczywistym. Sygnały stop mogą całkowicie przerwać taniec. Dopiero gdy wiadomość przetrwa kontrolę społeczną, ścieżka zasługuje na to, by nią podążyć.

WaggleDance jest zbudowany na tej logice.

Nie przekazuje problemu bezpośrednio do LLM. Najpierw kieruje go do właściwego rozwiązującego, waliduje wynik przez wiele agentów i używa modeli językowych tylko wtedy, gdy naprawdę pomagają. Każdy krok pozostawia ślad audytu. Każde rozwiązanie jest weryfikowalne. Każdy cykl zwiększa własną wiedzę systemu.

Taniec ósemkowy stał się algorytmicznym routingiem. Plaster miodu stał się strukturą pamięci MAGMA. A nocny sen pszczół stał się Dream Mode — symulacją, w której system analizuje porażki dnia, testuje tysiące alternatywnych ścieżek i budzi się mądrzejszy.

To nie metafora. To inżynieria inteligencji zbiorowej.

Pobierz, zrób fork i uruchom lokalnie od razu. Całe repo jest dostępne na GitHub bez rejestracji.

Licencja: Apache 2.0 + BUSL 1.1 (otwarty rdzeń + chronione moduły). Zobacz warunki na GitHub.

Data zmiany BUSL: 18 marca 2030.

Najpierw rozwiązujący. Walidator sprawdza. LLM wkracza tylko wtedy, gdy właściwy rozwiązujący nie wystarczy.

MAGMA zapisuje decyzje, źródła, odtworzenia i oceny zaufania. Zobacz, co się stało, dlaczego i w jakiej kolejności.

Dream Mode analizuje porażki, symuluje lepsze ścieżki i buduje lepsze modele na następny dzień.

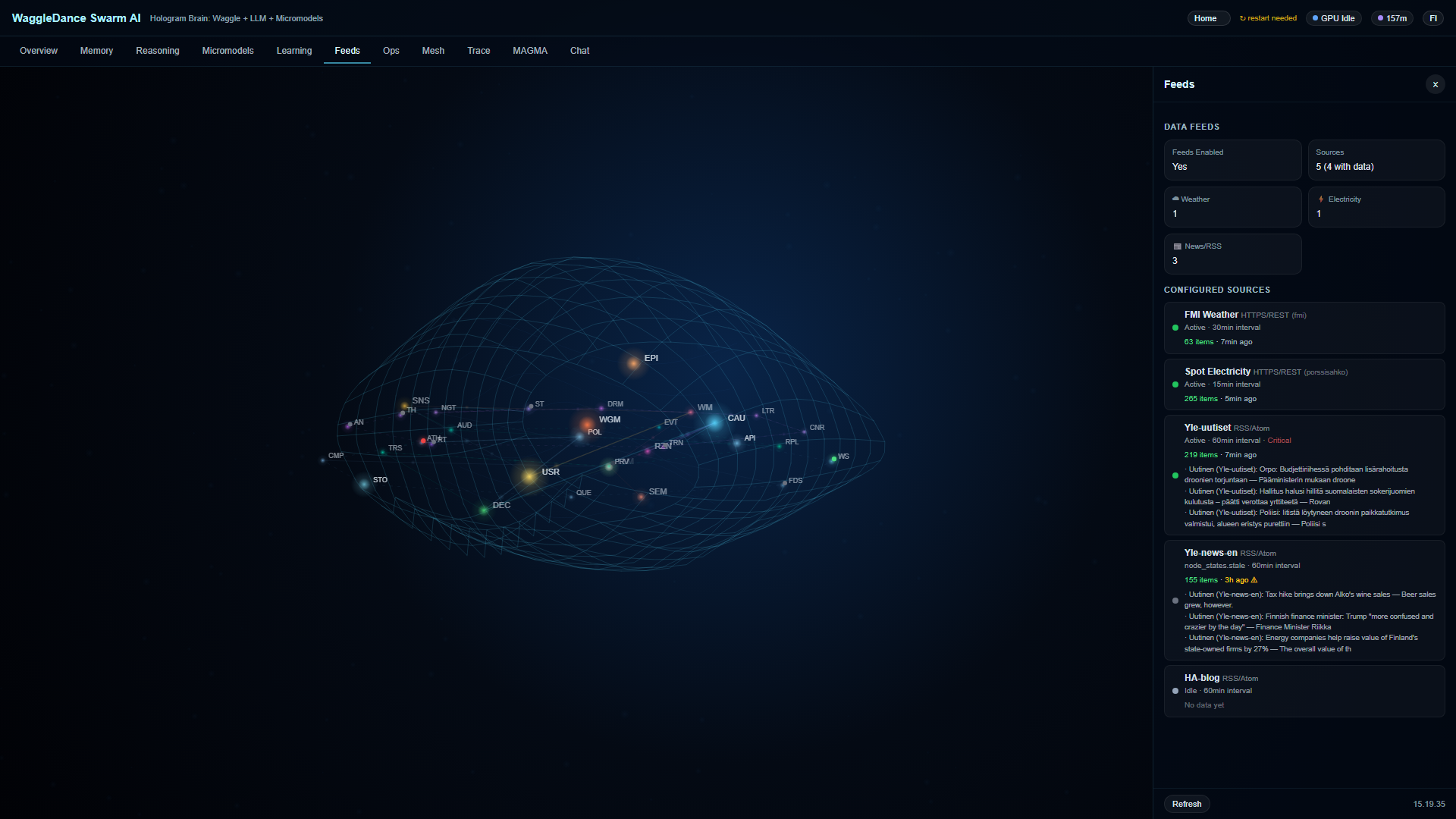

Hologram Brain uwidacznia stan 32 węzłów w czasie rzeczywistym. Nie widzisz czarnej skrzynki — widzisz działający system.

Wszystko działa we własnym środowisku. Bez obowiązkowej chmury, bez wychodzących danych promptów, bez zależności od SaaS.

Ten sam kod działa od Raspberry Pi po profil fabryczny. Nie tylko demo, nie tylko framework.

RPi, edge, czujnik

Offline, przerywane połączenie

Automatyka domowa

Monitoring, anomalie, audyt

Dashboard i Hologram Brain są dostępne natychmiast po uruchomieniu. Szybkość pierwszej odpowiedzi zależy od profilu, sprzętu i trybu (pełny lub stub).

Prompt jest wysyłany bezpośrednio do Grok — i kopiowany do schowka jako kopia zapasowa

Grok otwiera się w nowej karcie z gotowym promptem

Otrzymujesz dogłębną analizę repozytorium, punktowe porównanie z konkurencją i ocenę przydatności przemysłowej

Jeśli wypełnienie nie działa, wklej ręcznie — prompt już jest w twoim schowku.

Możesz użyć tego samego promptu w Claude, ChatGPT lub innym LLM. Grok jest domyślny na tej stronie.

Gdy klikniesz “Analizuj repozytorium”, system wykonuje dogłębną analizę:

Główna gałąź, struktura, moduły i ostatnie commity

Co jest zaimplementowane, a co zaplanowane lub aspiracyjne

Pokrycie testów, realistyczna dojrzałość i gotowość produkcyjna

Model pamięci, architektura audytu, pochodzenie danych i mechanizmy zaufania

Ocena 1-10 na sześciu osiach przeciw Dom Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Zastosowania przemysłowe, ryzyka, brakujące konektory, ograniczenia wdrożenia

Kliknij prompt, aby go skopiować. Wklej w sesji Grok dla głębszych badań.

Wybierz profil i otrzymaj spersonalizowany przewodnik wdrożenia od Grok.

Każde narzędzie poniżej jest dobre w tym, co robi. Porównanie pokazuje, jak architektura solver-first WaggleDance jest inna — nie, że inne są złe.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Dom Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Tak. Pobierz i uruchom od razu. Części Apache 2.0 są swobodnie używalne. Niekomercyjne użycie osobiste modułów chronionych BUSL jest dozwolone. Do użytku komercyjnego zobacz warunki licencji na GitHub.

Nie. WaggleDance jest zaprojektowany do pracy całkowicie offline na lokalnym sprzęcie. Internet jest potrzebny tylko do wstępnej konfiguracji i aktualizacji.

Minimum: Raspberry Pi 4 lub odpowiednik (profil GADGET). Zalecane: nowoczesny serwer x86 do orkiestracji multi-agent (profil FACTORY).

Otrzymujesz szybką drugą opinię techniczną na temat publicznego repo. Możesz użyć tego samego promptu w Claude, ChatGPT lub innym LLM.

Framework audytu i bootstrappu. Każda decyzja agentów jest zapisywana, aby zapewnić śledliwość, rollback i ocenę niezawodności.

Nocny tryb uczenia, w którym system analizuje porażki dnia, symuluje lepsze ścieżki i buduje lepsze modele na następny dzień — automatycznie, bez interwencji użytkownika.

Dashboard i Hologram Brain są natychmiast dostępne. Szybkość pierwszej odpowiedzi zależy od profilu i sprzętu.