Відправляють проблему прямо до мовної моделі й сподіваються, що відповідь буде правильною.

Природа вирішила цю проблему мільйони років тому.

У бджолиній сім'ї відкриття не стає рішенням через те, що одна бджола так вирішила. Розвідниця повертається до вулика і танцює вісімку на вертикальному стільнику — кут показує напрямок, довжина — відстань, сила — якість. Але танець не монолог. Сестри-бджоли слідкують за танцівницею, торкаються її вусиками та дають зворотний зв'язок у реальному часі. Сигнали зупинки можуть повністю перервати танець. Лише коли повідомлення переживає соціальну перевірку, шлях варто пройти.

WaggleDance побудований на цій логіці.

Він не передає проблему напряму до LLM. Спочатку маршрутизує її до правильного розв'язувача, валідує результат через кількох агентів і використовує мовні моделі лише тоді, коли вони справді допомагають. Кожен крок залишає слід аудиту. Кожне рішення перевіряється. Кожен цикл збільшує власні знання системи.

Танець-вісімка став алгоритмічною маршрутизацією. Стільники стали структурою пам’яті MAGMA. А нічний сон бджіл став Dream Mode — симуляцією, у якій система переглядає невдачі дня, тестує тисячі альтернативних шляхів і прокидається розумнішою.

Це не метафора. Це інженерія колективного інтелекту.

Завантаж, форкни та запусти локально відразу. Весь репозиторій доступний на GitHub без реєстрації.

Ліцензія: Apache 2.0 + BUSL 1.1 (відкрите ядро + захищені модулі). Див. умови на GitHub.

Дата зміни BUSL: 18 березня 2030.

Спочатку розв’язувачі. Валідатор перевіряє. LLM вступає лише тоді, коли правильного розв’язувача недостатньо.

MAGMA записує рішення, джерела, відтворення та оцінки довіри. Подивіться, що сталося, чому й у якому порядку.

Dream Mode переглядає невдачі, симулює кращі шляхи та будує кращі моделі до наступного дня.

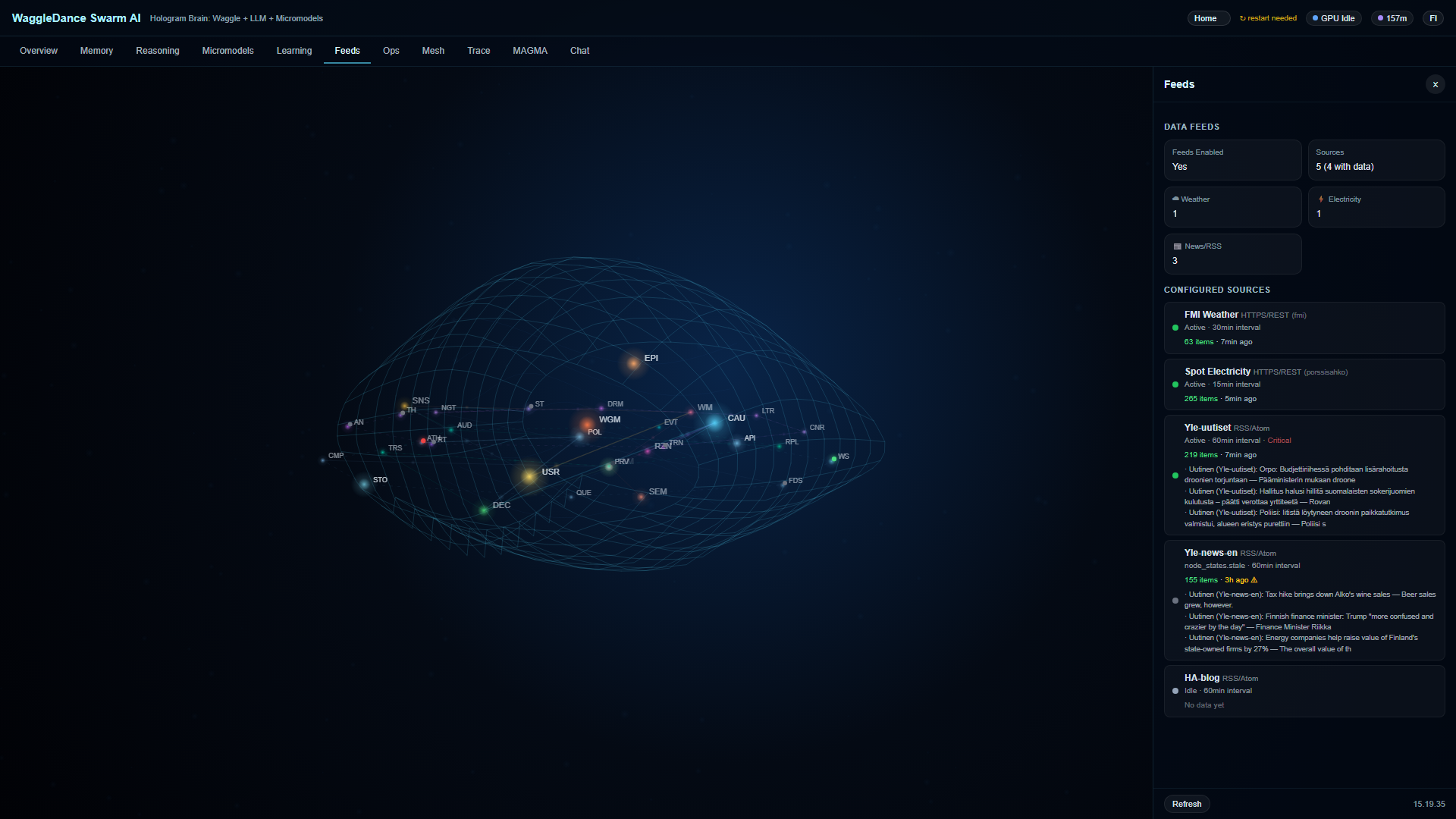

Hologram Brain робить стан 32 вузлів видимим у реальному часі. Ти бачиш не чорну скриньку — ти бачиш активну систему.

Усе працює у вашому власному середовищі. Без обов'язкової хмари, без виходу даних промптів назовні, без залежності від SaaS.

Той самий код працює від Raspberry Pi до фабричного профілю. Не лише демо, не лише фреймворк.

RPi, edge, сенсор

Офлайн, переривчасте з'єднання

Домашня автоматизація

Моніторинг, аномалії, аудит

Дашборд і Hologram Brain доступні відразу після запуску. Швидкість першої відповіді залежить від профілю, обладнання та режиму (повний чи stub).

Промпт відправляється прямо до Grok — і копіюється у буфер як резерв

Grok відкривається в новій вкладці з готовим промптом

Ти отримуєш глибокий аналіз репо, оцінене порівняння з конкурентами та оцінку промислової придатності

Якщо автозаповнення не працює, встав вручну — промпт уже в буфері.

Ти можеш використати той самий промпт у Claude, ChatGPT чи іншому LLM. Grok — за замовчуванням на цій сторінці.

Коли натискаєш “Проаналізувати репо”, система виконує глибокий аналіз:

Головна гілка, структура, модулі та останні коміти

Що реалізовано, а що заплановано або є цільовим

Покриття тестами, реалістична зрілість та готовність до продукції

Модель пам'яті, архітектура аудиту, походження даних і механізми довіри

Оцінка 1-10 на шести осях проти Дім Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Промислові сценарії, ризики, відсутні конектори, обмеження розгортання

Натисни на промпт, щоб скопіювати. Встав у сесію Grok для глибшого дослідження.

Обери профіль і отримай персоналізований гайд розгортання від Grok.

Кожен інструмент нижче добрий у тому, що робить. Порівняння показує, як solver-first архітектура WaggleDance відрізняється — не те, що інші погані.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Дім Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Так. Завантаж і запускай відразу. Частини Apache 2.0 вільно доступні. Некомерційне особисте використання захищених BUSL модулів дозволене. Для комерційного використання див. умови ліцензії на GitHub.

Ні. WaggleDance розроблений для повної оффлайн-роботи на локальному обладнанні. Інтернет потрібний лише для початкового налаштування та оновлень.

Мінімум: Raspberry Pi 4 або аналог (профіль GADGET). Рекомендовано: сучасний x86-сервер для оркестрації багатоагентної системи (профіль FACTORY).

Отримаєш швидку другу технічну думку про публічне репо. Можна використовувати той самий промпт у Claude, ChatGPT чи іншому LLM.

Фреймворк аудиту та запуску. Кожне рішення агентів записується для забезпечення відстежуваності, відкоту та оцінки надійності.

Нічний режим навчання, у якому система переглядає невдачі дня, симулює кращі шляхи та будує кращі моделі до наступного дня — автоматично, без втручання користувача.

Дашборд і Hologram Brain доступні відразу. Швидкість першої відповіді залежить від профілю та обладнання.