Inviano il problema direttamente al modello linguistico e sperano che la risposta sia giusta.

La natura ha risolto questo problema milioni di anni fa.

In un alveare, una scoperta non diventa una decisione perché un'ape decide da sola. L'ape esploratrice torna all'alveare e danza un otto sul favo verticale — l'angolo indica la direzione, la lunghezza la distanza, il vigore la qualità. Ma la danza non è un monologo. Le api sorelle seguono la danzatrice, la toccano con le antenne e forniscono feedback in tempo reale. I segnali di stop possono interrompere completamente la danza. Solo quando il messaggio supera il controllo sociale il percorso merita di essere percorso.

WaggleDance è costruito su questa logica.

Non consegna il problema direttamente a un LLM. Lo instrada prima al solutore giusto, convalida il risultato attraverso più agenti e usa i modelli linguistici solo quando aiutano davvero. Ogni passo lascia una traccia verificabile. Ogni soluzione è controllabile. Ogni ciclo accresce la conoscenza del sistema.

La danza dell'otto è diventata instradamento algoritmico. Il favo è diventato la struttura di memoria MAGMA. E il riposo notturno delle api è diventato Dream Mode — una simulazione in cui il sistema rivede i fallimenti del giorno, testa migliaia di percorsi alternativi e si sveglia più intelligente.

Non è una metafora. È l'ingegneria dell'intelligenza collettiva.

Scarica, fork e avvia in locale subito. L'intero repo è disponibile su GitHub senza registrazione.

Licenza: Apache 2.0 + BUSL 1.1 (open core + moduli protetti). Vedi i termini su GitHub.

Data di cambio BUSL: 18 marzo 2030.

I solutori vanno prima. Il validatore controlla. L'LLM interviene solo quando il solutore giusto non basta.

MAGMA registra decisioni, fonti, replay e punteggi di fiducia. Vedi cosa è successo, perché e in quale ordine.

Dream Mode rivede i fallimenti, simula percorsi migliori e costruisce modelli più efficaci per il giorno successivo.

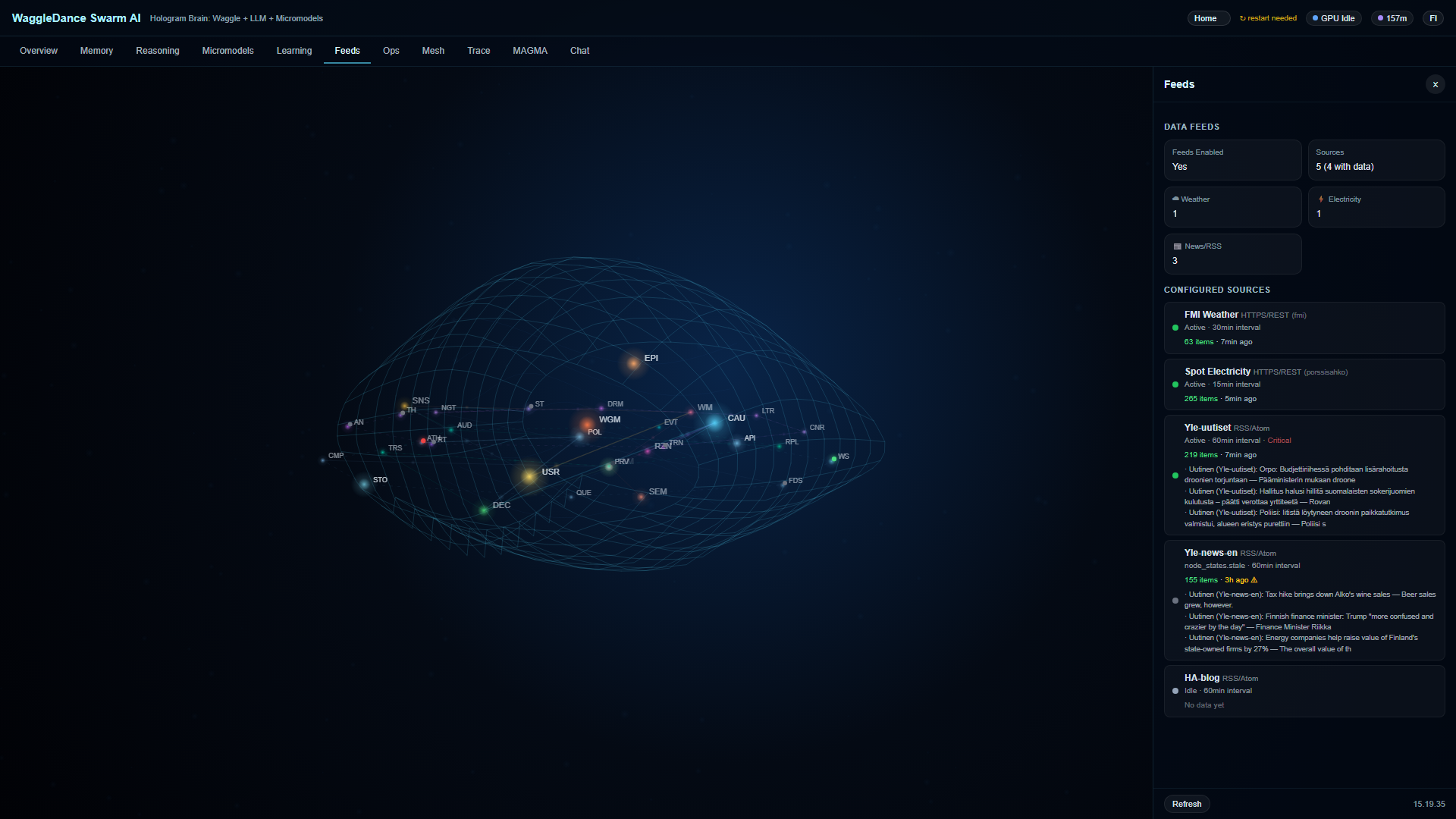

Hologram Brain rende visibile lo stato di 32 nodi in tempo reale. Non vedi una scatola nera — vedi un sistema attivo.

Tutto funziona nel tuo ambiente. Nessun cloud obbligatorio, nessun dato dei prompt in uscita, nessuna dipendenza SaaS.

Lo stesso codice funziona dal Raspberry Pi al profilo factory. Non solo demo, non solo framework.

RPi, edge, sensore

Offline, connettività discontinua

Automazione domestica

Monitoraggio, anomalie, revisione

Dashboard e Hologram Brain disponibili subito dopo l'avvio. La velocità della prima risposta dipende dal profilo, dall'hardware e dalla modalità (completa o stub).

Il prompt viene inviato direttamente a Grok — e copiato negli appunti come backup

Grok si apre in una nuova scheda con il prompt già pronto

Ricevi un'analisi approfondita del repo, un confronto con i concorrenti e una valutazione per uso industriale

Se la pre-compilazione non funziona, incolla manualmente — il prompt è già negli appunti.

Puoi usare lo stesso prompt anche con Claude, ChatGPT o qualsiasi altro LLM. Grok è il predefinito su questa pagina.

Quando clicchi “Analizza il repo”, il sistema esegue un'analisi approfondita:

Branch principale, struttura, moduli e commit recenti

Cosa è implementato rispetto a cosa è pianificato o aspirazionale

Copertura dei test, maturità realistica e disponibilità alla produzione

Modello di memoria, architettura di audit, provenienza e meccanismi di fiducia

Punteggio 1-10 su sei assi contro Casa Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Casi d'uso industriali, rischi, connettori mancanti, vincoli di distribuzione

Clicca su un prompt per copiarlo. Incollalo nella sessione Grok per approfondire.

Scegli un profilo e ricevi una guida di distribuzione personalizzata da Grok.

Ogni strumento qui sotto è ottimo in ciò che fa. Il confronto mostra come l'approccio solver-first di WaggleDance sia diverso — non che gli altri siano peggiori.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Casa Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Sì. Scarica e avvia subito. Le parti Apache 2.0 sono liberamente utilizzabili. L'uso personale non commerciale dei moduli protetti BUSL è consentito. Per uso commerciale, vedi i termini su GitHub.

No. WaggleDance è progettato per funzionare completamente offline su hardware locale. Internet è necessario solo per l'installazione iniziale e gli aggiornamenti.

Minimo: Raspberry Pi 4 o equivalente (profilo GADGET). Consigliato: server x86 moderno per orchestrazione multi-agente (profilo FACTORY).

Ottieni una seconda opinione tecnica rapida sul repo pubblico. Puoi usare lo stesso prompt con Claude, ChatGPT o qualsiasi altro LLM.

Framework di revisione e avvio. Ogni decisione degli agenti è registrata per garantire tracciabilità, ripristino e valutazione dell'affidabilità.

Modalità di apprendimento notturno in cui il sistema rivede i fallimenti del giorno, simula percorsi migliori e costruisce modelli più efficaci per il giorno successivo — automaticamente, senza intervento dell'utente.

Dashboard e Hologram Brain sono disponibili immediatamente. La velocità della prima risposta dipende dal profilo e dall'hardware.