De frågar språkmodellen först och hoppas att svaret låter rätt.

Naturen löste detta problem för miljontals år sedan.

I en bikupa blir en upptäckt inte ett beslut bara för att en aktör säger det. En spanare återvänder till kupan och dansar en åttafigur på den lodräta vaxkakan — den raka delens vinkel anger riktning, dansens längd anger avstånd, vigören anger kvalitet. Men dansen är ingen monolog. Systerbin följer dansaren, känner på henne med sina antenner och ger realtidsåterkoppling. Stoppsignaler kan avbryta dansen helt. Endast när budskapet överlever samhällets granskning uppstår en rutt värd att följa.

WaggleDance är byggt på denna logik.

Den lämnar inte problemet direkt till en LLM. Den dirigerar det först till rätt lösare, verifierar resultatet med flera agenter och använder språkmodeller endast när de verkligen hjälper. Varje steg lämnar ett granskningsspår. Varje lösning är motiverbar. Varje cykel bygger upp systemets egen expertis.

Åttafigursdansen blev algoritmisk dirigering. Vaxkakan blev MAGMA-minnesstrukturen. Och binas nattliga vila blev Dream Mode — en simulering där systemet granskar dagens misslyckanden, testar tusentals alternativa rutter och vaknar upp smartare.

Detta är ingen metafor. Detta är en arkitektur för kollektiv maskinintelligens.

Ladda ner, forka och kör lokalt direkt. Hela repositöriet finns på GitHub utan registrering.

Licensmodell: Apache 2.0 + BUSL 1.1 (öppen kärna + källköpta skyddade moduler). Se villkor på GitHub.

BUSL-övergångsdatum: 18 mars 2030.

Lösare går först. Verifieraren kontrollerar. LLM:en kopplas in bara när rätt lösare inte räcker till.

MAGMA registrerar beslut, källor, återuppspelningar och tillitspoäng. Se vad som hände, varför och i vilken ordning.

Dream Mode granskar misslyckanden, simulerar bättre rutter och bygger bättre modeller till nästa dag.

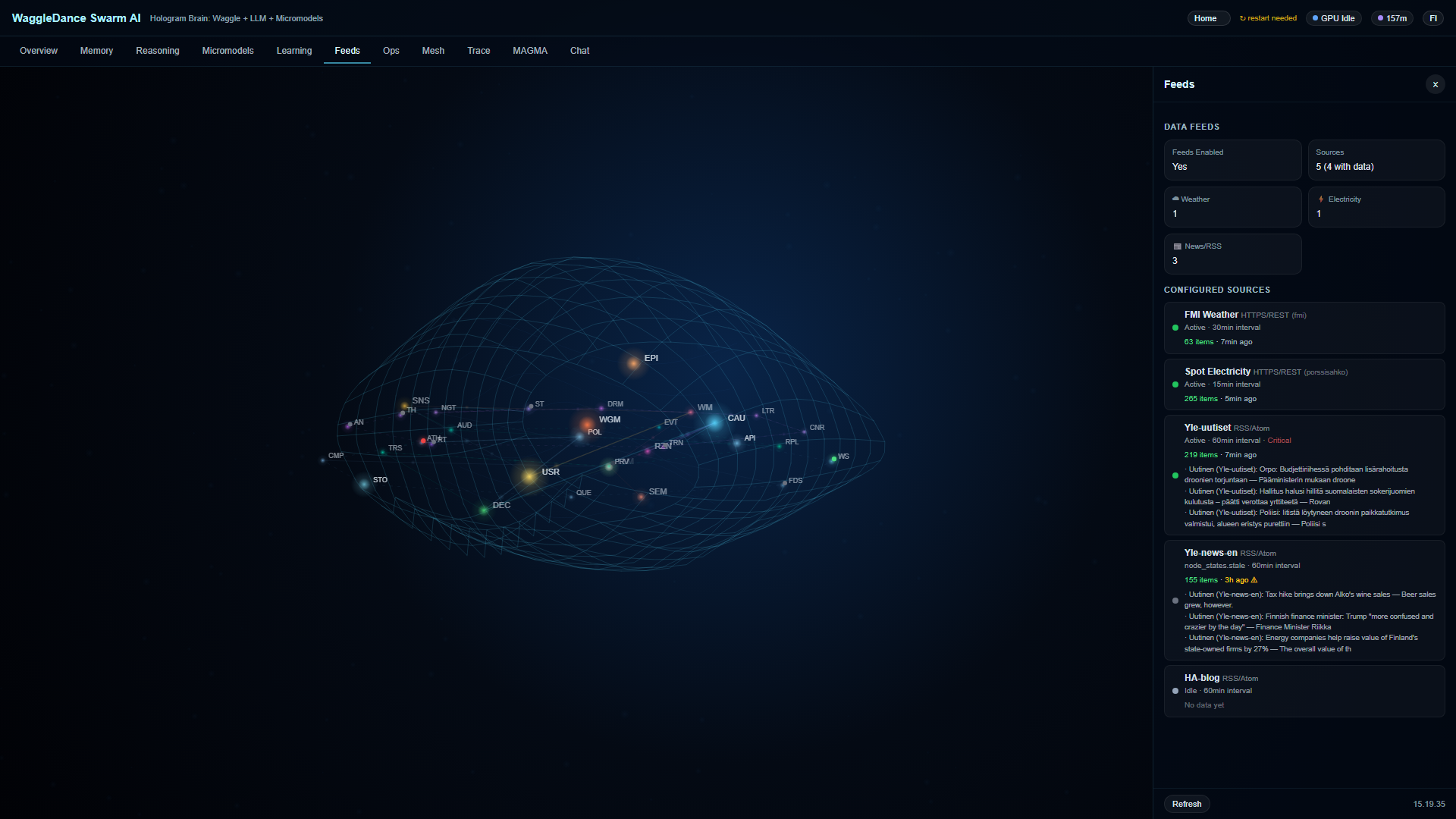

Hologram Brain gör tillståndet för 32 noder synligt i realtid. Du tittar inte på en svart låda — du tittar på ett fungerande system.

Allt körs i din egen miljö. Inget obligatoriskt moln, ingen promptdata lämnar miljön, inget SaaS-beroende.

Samma kodbas fungerar från Raspberry Pi till fabriksprofil. Inte bara en demo, inte bara ett ramverk.

RPi, edge, sensor

Offline, intermittent anslutning

Lokal automation

Övervakning, avvikelser, granskning

Dashboard och Hologram Brain är tillgängliga omedelbart efter start. Första responstiden beror på profil, hårdvara och full- eller stub-läge.

Prompten skickas direkt till Grok — och kopieras till ditt urklipp som säkerhetskopia

Grok öppnas i en ny flik med prompten redo

Du får en heltäckande analys av repositöriet, en poängsatt konkurrentjämförelse och en bedömning av fabriksberedskap.

Om förifyllningen inte fungerar, klistra in manuellt — prompten finns redan på ditt urklipp.

Du kan också använda samma prompt i Claude, ChatGPT eller valfri annan LLM. Grok är standardvalet på denna sida.

När du klickar på “Analysera repositörium” utför AI:n en djup analys som omfattar:

Huvudgren, arkitektur, moduler och senaste commits

Vad som är implementerat kontra vad som är planerat eller strategiskt

Testtäckning, praktisk mognad och produktionsberedskap

Minnesmodell, granskningsarkitektur, proveniens och tillitsmekanismer

Poängsatt 1–10 på sex axlar mot Hem Assistant, Node-RED, n8n, Open WebUI, LangGraph, AutoGen, CrewAI, Ollama

Industriella användningsfall, risker, saknade integrationer, driftsättningshinder

Klicka på en prompt för att kopiera den. Klistra in i din Grok-session för djupare utforskning.

Välj en profil och få en skräddarsydd driftssättningsguide från Grok.

Varje verktyg nedan är bra på det det gör. Jämförelsen visar hur WaggleDances solver-first-arkitektur skiljer sig — inte för att påstå att andra är dåliga.

clone → docker compose up -d — Ollama, Voikko (Finnish NLP), and the app all in one.No competitor improves autonomously over time. WaggleDance is the only one that builds cumulative expertise.

| Time | WaggleDance | Hem Assistant | LangGraph | AutoGen/CrewAI | Node-RED/n8n | Ollama |

|---|---|---|---|---|---|---|

| Day 1 | LLM fallback ~30-50%, solvers learning | Same as always | Same as always | Same as always | Same as always | Same as always |

| Month 1 | HotCache fills, LLM ~20-30%, first canary promotions | No change | No change | No change | No change | No change |

| Month 6 | LLM ~10-15%, specialists maturing, ~180 nights of Dream Mode | No change | No change | No change | No change | No change |

| Year 1 | LLM ~5-8%, MAGMA with thousands of audited paths | No change | No change | No change | No change | No change |

| Year 2 | LLM <3-5%, >95% deterministic, TCO a fraction of day 1 | No change | No change | No change | No change | No change |

The competitors' column is empty everywhere except day 1. They don't learn. They don't improve. On day 730, they are exactly the same as on day 1.

Yes. Download and run immediately. Apache 2.0 parts are freely usable. Non-commercial personal use of BUSL-protected modules is permitted. For commercial use, check the license terms on GitHub.

No. WaggleDance is designed to work fully offline on local hardware. Internet is only needed for initial setup and updates.

Minimum: Raspberry Pi 4 or equivalent (GADGET profile). Recommended: modern x86 server for multi-agent orchestration (FACTORY profile).

You get a quick second technical opinion on the public repo, documentation, and competitive landscape. You can use the same prompt in Claude, ChatGPT, or any other LLM.

An auditing and provenance framework. Every agent decision is recorded so you get traceability, replay, and trust assessment visibility.

An overnight learning mode where the system reviews the day's failures, simulates better routes, and builds better models for the next day — automatically without user action.

Dashboard and Hologram Brain are available immediately. First response speed depends on profile and hardware.